Le marquage des produits et contenus originaux est une pratique bien connue chez leurs créateurs pour vérifier leur authenticité et les protéger contre le vol et l’imitation. Cette pratique est adaptée pour répondre au besoin de marquage des documents numériques, plus faciles à copier et à transférer. Ce besoin a donné naissance à un nouveau concept de marquage qui est le tatouage numérique.

Le tatouage numérique est une technique qui consiste à insérer un message appelé marque dans un document numérique (qui peut être une image, une base de données, un modèle d’intelligence artificielle (IA), etc.) pour assurer souvent, mais pas seulement, la protection des droits d’auteur. Dans cet article, nous nous intéressons particulièrement au tatouage des modèles de deep learning (DL). Ainsi, il semble intéressant de commencer par présenter les concepts de base du tatouage numérique et de détailler ses techniques traditionnelles pour ensuite passer aux techniques appliquées au tatouage des modèles DL.

Le tatouage a plusieurs cas d’utilisation tel que la protection de droit d’auteur. En outre, il est utilisé pour le traçage (fingerprinting), en insérant une marque différente dans chaque élément livré. Ainsi, il est possible d’identifier la personne responsable de la divulgation des données. Un autre cas d’usage est le contrôle d’intégrité. Dans ce cas, une signature est insérée pour vérifier si le document a été altéré.

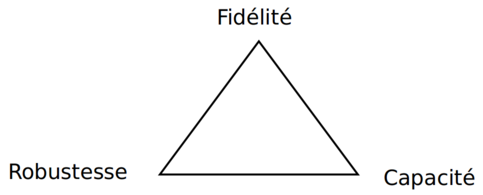

Lorsque nous parlons de tatouage, il y a un triangle auquel nous pensons directement, dans lequel il y a un compromis entre la fidélité, la capacité et la robustesse. Donc lorsque quelqu’un réfléchit à faire du tatouage numérique il faut qu’il se place dans ce triangle en fonction de ses besoins de sécurité.

(Exigences sur la méthode de tatouage numérique)

La fidélité représente le pouvoir du document numérique à compléter la tâche pour laquelle il a été conçu.

La capacité est la taille de message que nous pouvons insérer.

La robustesse est la résistance du tatouage aux manipulations extérieures.

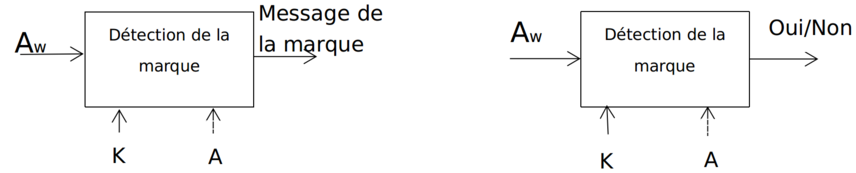

Selon le cas d’usage, le tatouage peut être multi-bit ou zéro bit. Dans le premier cas, la marque est un message composé de plusieurs bits qui est récupéré lors de la phase d’extraction. Quant au second, la phase d’extraction permet uniquement de vérifier l’existence ou non d’une marque.

(Tatouage multi-bit vs tatouage zéro bit)

Une marque peut subir différentes manipulations :

Il y a d’abord les manipulations malicieuses dans laquelle un attaquant vise à endommager ou à enlever la marque ;

puis, il y a les manipulations non-malicieuses qui s’explique dans les traitements involontaires ou inévitables qui peuvent perturber la marque cachée, comme la compression par exemple.

A partir de ces définitions, le tatouage peut être classé en :

Tatouage fragile qui ne résiste à aucune de ces manipulations. Il est utilisé pour la vérification d’intégrité.

Tatouage robuste qui peut résister aux manipulations non-malicieuses.

Tatouage sécurisé qui survit aussi aux manipulations malicieuses.

Il existe deux manières pour faire la détection, soit par détection aveugle, soit par détection non aveugle. La différence entre les deux est que dans le premier cas la marque est récupérée sans avoir besoin de comparer le modèle non-tatoué et le modèle tatoué. Dans le deuxième nous utilisons le contenu original non-tatoué pour l’extraction de la marque.

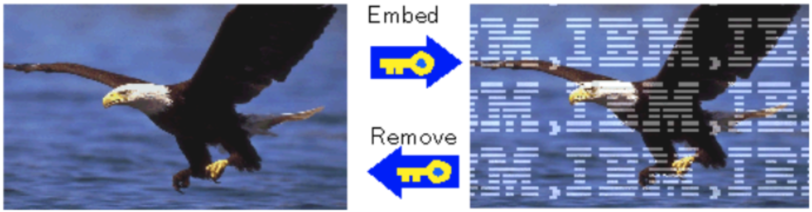

Les premières méthodes de tatouage numérique des images ont été développées par le laboratoire de recherche IBM de Tokyo pour des applications telles que la distribution de contenu en ligne. Comme le montre la figure, l’image sert de teaser que les utilisateurs peuvent visualiser et obtenir gratuitement. La marque sera supprimée si les utilisateurs s’acquittent de frais supplémentaires.

(Exemple de tatouage des images par la méthode d’IBM)

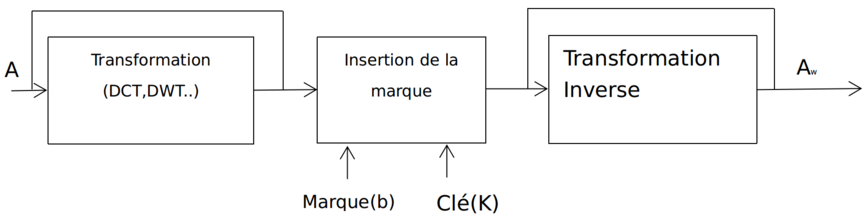

Généralement, les techniques traditionnelles sont basées sur la transformation des objets en une autre représentation, par exemple une représentation spectrale ou autre, à l’aide d’une transformation (transformée en cosinus, transformée de Fourier, transformée en ondelettes, etc.). Ensuite, la marque est insérée et l’objet est retransformé en sa représentation initiale à l’aide de la transformation inverse. Une clé est utilisée lors de l’insertion de la marque afin de garantir que personne ne puisse l’enlever même s’il connaît la technique d’insertion.

(Principe de fonctionnement des techniques de tatouage traditionnelles)

Bien que les concepts de tatouage décrits dans la section précédente peuvent être largement appliqués aussi au tatouage des modèles DL, deux autres nouvelles caractérisations spécifiques au tatouage DL ont été ajoutées :

l’extraction de marque en boite blanche si les paramètres internes du modèle DL sont disponibles,

ou la récupération de la marque en boite noire si seulement la sortie du modèle est disponible.

Une autre distinction très importante des technologies de tatouage DL est à noter :

les méthodes statiques où l’insertion de la marque se fait dans les poids du modèle DL. Ces poids sont déterminés dans la phase d’entraînement et ont une valeur fixe qui ne dépend pas des entrées du modèle.

les méthodes dynamiques où la marque est associée au comportement du modèle en correspondance à des entrées spécifiques.

Le sens des exigences définies précédemment diffère lorsqu’il s’agit du tatouage DL. Pour la robustesse, la marque insérée doit résister aux différents types de traitement comme le fine tunning (ré-entrainer un modèle pour faire une autre tâche) et Network pruning (simplifier un modèle DL complexe en supprimant les neurones et les liens non significatifs). En ce qui concerne la sécurité, la marque doit être sécurisée contre les attaques intentionnelles comme l’attaque de :

Ré-écriture de la marque : un attaquant qui connaît la méthodologie utilisé pour insérer la marque mais ne connaît pas la clé peut essayer d’insérer une nouvelle marque et écraser l’ancienne.

Extraction du modèle : un attaquant tente de répliquer la fonctionnalité d’un DNN cible, en l’utilisant pour annoter une nouvelle base de données. Cette base de données servira à entraîner un nouveau modèle qui imite l’original.

Quant à la fidélité, elle signifie dans ce cas que l’insertion de la marque ne doit pas affecter significativement la précision de l’architecture du modèle DL. La capacité dans le tatouage multi-bit, le schéma de tatouage doit allouer l’insertion du maximum possible d’information dans le modèle DL cible.

L’intégrité est que le taux d’erreur binaire (ou bien le BER) doit être égale à zéro ou négligeable dans le cas du tatouage multi-bit et que la probabilité de fausse alarme et la détection échouée soit très faible dans le cas zéro-bit. Deux nouvelles exigences qui s’ajoutent dans le cas de tatouage DL. La première est la généralisation qui se résume dans applicabilité de la méthodologie de tatouage sur les différentes architectures et bases de données. La deuxième est l’efficience qui signifie que l’insertion et l’extraction de la marque doivent être négligeable en terme de calcul.

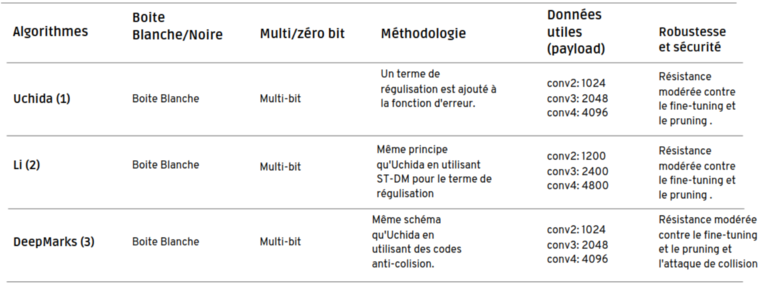

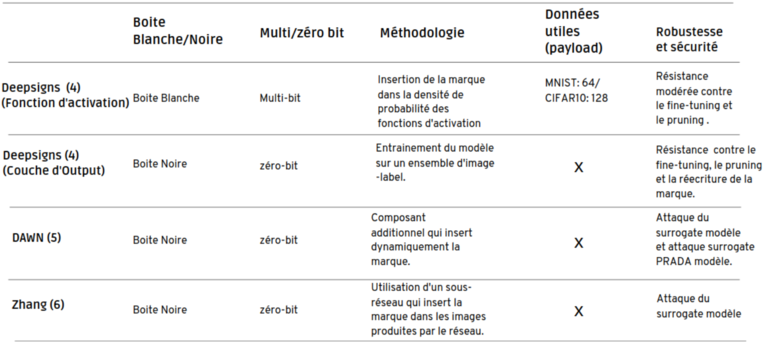

Avec les développements dans le domaine du deep learning, plusieurs méthodes de tatouage ont été proposées. Le tableau suivant résume ces méthodes en détaillant leurs caractéristiques.

(Résumé des techniques de tatouage statiques)

(Résumé des techniques de tatouage dynamiques)

Comme présenté précédemment, il existe plusieurs méthodes de tatouage numérique pour les modèles DL permettant de lutter contre plusieurs types de manipulations malicieuses ou non-malicieuses. Malgré que le tatouage dynamique offre plusieurs nouvelles opportunités, il reste beaucoup de questions auxquelles nous devons répondre pour mieux comprendre ses potentiels :

Combien de données de déclenchement (données qui provoquent un comportement de prédiction inhabituel dans le modèle marqué) peut-on définir sans affecter la performance du modèle ?

Est-il préférable que les données de déclenchement suivent la même distribution que les données standard ou doivent-elles avoir une distribution différente ?

Quel est l’impact du fine tuning , du ré-entraînement , du pruning , sur le comportement du modèle en fonction des entrées de déclenchement de la marque?

La robustesse face au fine tuning , au pruning du modèle et, encore plus, l’apprentissage par transfert, est l’un des défis les plus difficiles à relever. Il est donc important de développer une technique de tatouage qui soit résistante à différents types d’attaques. Dans ce contexte, l’exploitation des points forts des techniques existantes peut être une approche à suivre. Cependant, les méthodes de tatouage permettant de lutter contre l’extraction du modèle restent un sujet peu développé. En effet, les techniques existantes sont basées sur l’insertion dynamique d’une marque dans la sortie du modèle. Bien que cette solution soit très efficace dans le cas où la sortie est une image (insertion d’une marque visible), elle est inutile dans le cas où la sortie est une classe ou un score. Dans ce contexte, le problème n’est plus de protéger le modèle de DL mais plutôt de protéger l’expertise intégrée dans le modèle.

(1) Uchida, Y., Nagai, Y., Sakazawa, S., Satoh, S., 2017. Embedding watermarks into deep neural networks, in: Proceedings of the 2017 ACM on International Conference on Multimedia Retrieval, pp. 269–277

(2) Li, Y., Tondi, B., Barni, M., 2020a. Spread-transform dither modulation watermarking of deep neural network. arXiv preprint arXiv:2012.14171

(3) Chen, H., Rouhani, B.D., Fu, C., Zhao, J., Koushanfar, F., 2019c. Deepmarks: A secure fingerprinting framework for digital rights management of deep learning models, in: Proceedings of the 2019 on In-ternational Conference on Multimedia Retrieval, pp. 105–113

(4) Rouhani, B.D., Chen, H., Koushanfar, F., 2019. Deepsigns: an end-to-end watermarking framework for protecting the ownership of deep neural networks, in: The 24th ACM International Conference on Architectural Support for Programming Languages and Operating Systems (ASPLOS). ACM

(5) Szyller, S., Atli, B.G., Marchal, S., Asokan, N., 2019. Dawn: Dynamic adversarial watermarking of neural networks. arXiv preprintarXiv:1906.00830

(6) Zhang, J., Chen, D., Liao, J., Fang, H., Zhang, W., Zhou, W., Cui, H.,Yu, N., 2020. Model watermarking for image processing networks,in: Proceedings of the AAAI Conference on Artificial Intelligence,Association for the Advancement of Artificial Intelligence (AAAI).pp. 12805–12812. doi: 10.1609/aaai.v34i07.6976

Cover Photo by Michael Dziedzic on Unsplash